InfiniBand(简称IB)是一种高性能、低延迟的网络互连技术,广泛应用于高性能计算(HPC)、数据中心和人工智能等领域。其核心硬件组件——InfiniBand网卡,凭借一系列卓越特性,为现代计算系统的软硬件技术开发提供了强大的底层支撑。

一、InfiniBand网卡的核心特性

1. 超高带宽与低延迟:

当前主流的InfiniBand网卡(如HDR 200Gbps、NDR 400Gbps)提供了远超传统以太网的带宽。更重要的是,其端到端延迟可低至亚微秒级,这对于需要频繁进行小消息通信的并行计算应用至关重要。

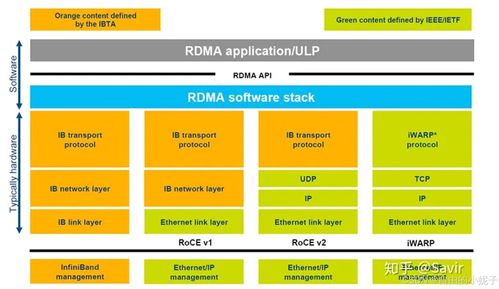

2. 远程直接内存访问(RDMA):

这是IB网卡的标志性功能。RDMA允许网络适配器直接访问对方主机的内存,无需操作系统内核和CPU的介入。这实现了“零拷贝”数据传输,极大降低了CPU开销,提升了通信效率和系统整体性能。

3. 内核旁路(Kernel Bypass):

与RDMA紧密相关,应用程序可以直接与网卡交互,绕过繁琐的内核协议栈。这减少了上下文切换和系统调用,进一步降低了延迟,使通信性能更加可预测。

4. 传输卸载与硬件加速:

IB网卡在硬件层面实现了传输层协议(如可靠连接、数据包排序、流量控制)的卸载。这包括拥塞控制、原子操作、多播等高级功能的硬件加速,将CPU从繁重的网络协议处理中解放出来。

5. 可扩展性与服务质量(QoS):

IB架构天然支持大规模集群的线性扩展。其基于信用的流控机制和虚拟通道(VL)技术,能够为不同流量提供差异化的服务质量保障,确保关键应用的低延迟和高吞吐。

6. 高能效比:

在处理相同数据量时,IB网卡凭借高效的硬件卸载和RDMA技术,通常比传统TCP/IP over Ethernet消耗更少的CPU资源和系统功耗,实现更高的能效比。

二、在计算机软硬件技术开发中的关键作用

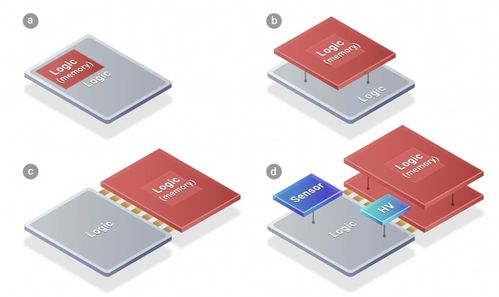

1. 硬件架构创新:

IB网卡的高性能特性,推动了服务器和存储系统硬件架构的演进。例如,在异构计算系统中,CPU、GPU、FPGA等加速器可以通过IB网络直接进行高速内存访问(如GPUDirect RDMA),实现计算资源的紧密耦合与高效协同,为AI训练和科学计算等负载提供近乎线性的扩展能力。硬件开发者需深入研究IB网卡的PCIe接口规范、散热设计和信号完整性,以充分发挥其性能。

2. 系统软件与中间件开发:

操作系统和虚拟化层需要提供对IB和RDMA的原生支持。这包括:

- 驱动与协议栈开发:如Linux内核中的

mlx5<em>ib驱动、rdma</em>cm通信管理器以及用户态的libibverbs和librdmacm库。开发者需要优化这些软件层,以最小化软件开销。

- 虚拟化与云化支持:开发SR-IOV(单根I/O虚拟化)等技术,让虚拟机或容器能够直接、安全地访问物理IB设备,在云环境中保持高性能网络特性。

- 并行编程模型集成:主流的消息传递接口(MPI)实现(如Open MPI, MVAPICH)深度集成RDMA,开发者可以基于此构建低延迟的并行应用程序。

3. 存储系统开发:

IB是构建高性能存储网络(如SAN)和分布式存储系统(如Lustre, Ceph)的基石。通过IB网卡的RDMA功能,可以实现存储服务器的远程内存直接访问,构建极低延迟的块存储(如NVMe over Fabrics - NVMe-oF)和文件系统,极大加速大数据和AI工作负载的数据访问速度。

4. 网络协议与算法优化:

软硬件协同设计是核心。开发者可以在IB的稳定物理层和链路层之上,针对特定应用(如机器学习参数同步、金融交易)设计和优化上层通信协议与算法,充分利用硬件卸载特性。例如,设计高效的集合通信原语,以匹配All-Reduce等操作的硬件加速能力。

5. 性能调优与诊断工具开发:

为了充分发挥IB网络的潜力,需要开发一系列性能监控(如使用perfquery、ibstat)、调试和诊断工具。这包括对计数器、拥塞控制事件、错误信息的深入分析,以及开发可视化平台来洞察大规模IB网络的健康状况和性能瓶颈。

与展望

InfiniBand网卡以其革命性的RDMA、超高带宽和超低延迟特性,已成为驱动前沿计算技术发展的关键基础设施组件。在软硬件技术开发中,它不仅是实现极致性能的“加速器”,更催生了从硬件设计、系统软件到应用框架的全栈创新。随着计算需求向更密集的AI、更复杂的科学模拟发展,对IB网卡特性(如更高速率、更强隔离性、更智能的拥塞控制)的深入理解和应用,将继续是高性能计算和云数据中心技术开发者必须掌握的核心竞争力。与新兴计算范式(如存算一体、量子计算经典接口)的结合,将进一步拓展其技术开发的疆界。